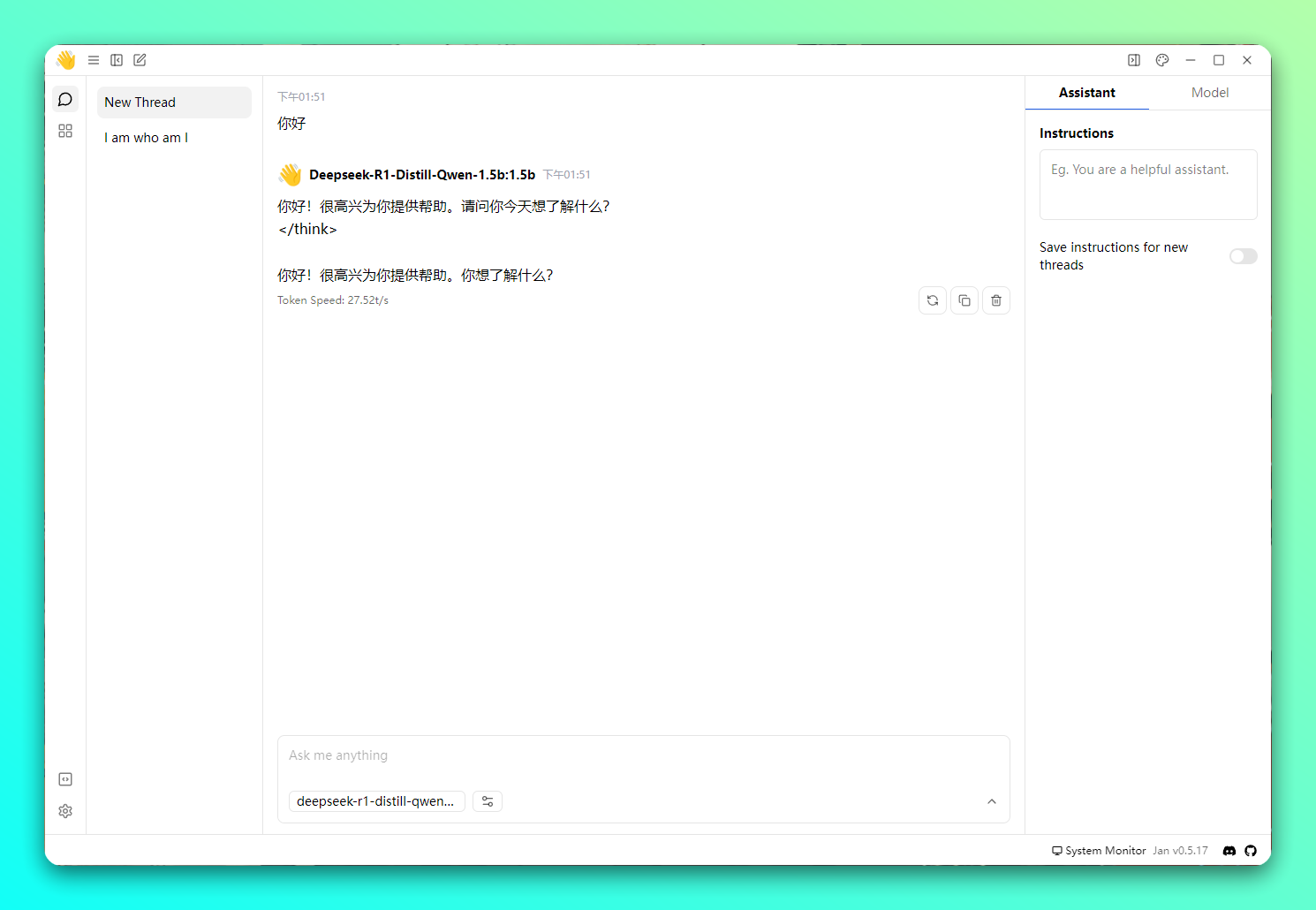

DeepSeek 导航网:想要在本地部署 DeepSeek 的模型,之前给大家分享用 LM Studio、Ollama 等工具,不过对于一些新手小白来说还是比较麻烦。今天给大家推荐这款「Jan」开源的本地 AI 模型运行工具,支持在 Windows、macOS、Linux 系统上离线部署和运行大语言模型,例如:LLaMA、Mistral、DeepSeek 等。

功能特色

- 本地优先与隐私保护:所有对话数据、模型文件均存储在本地文件系统中,无需联网即可运行,确保敏感信息不外泄。

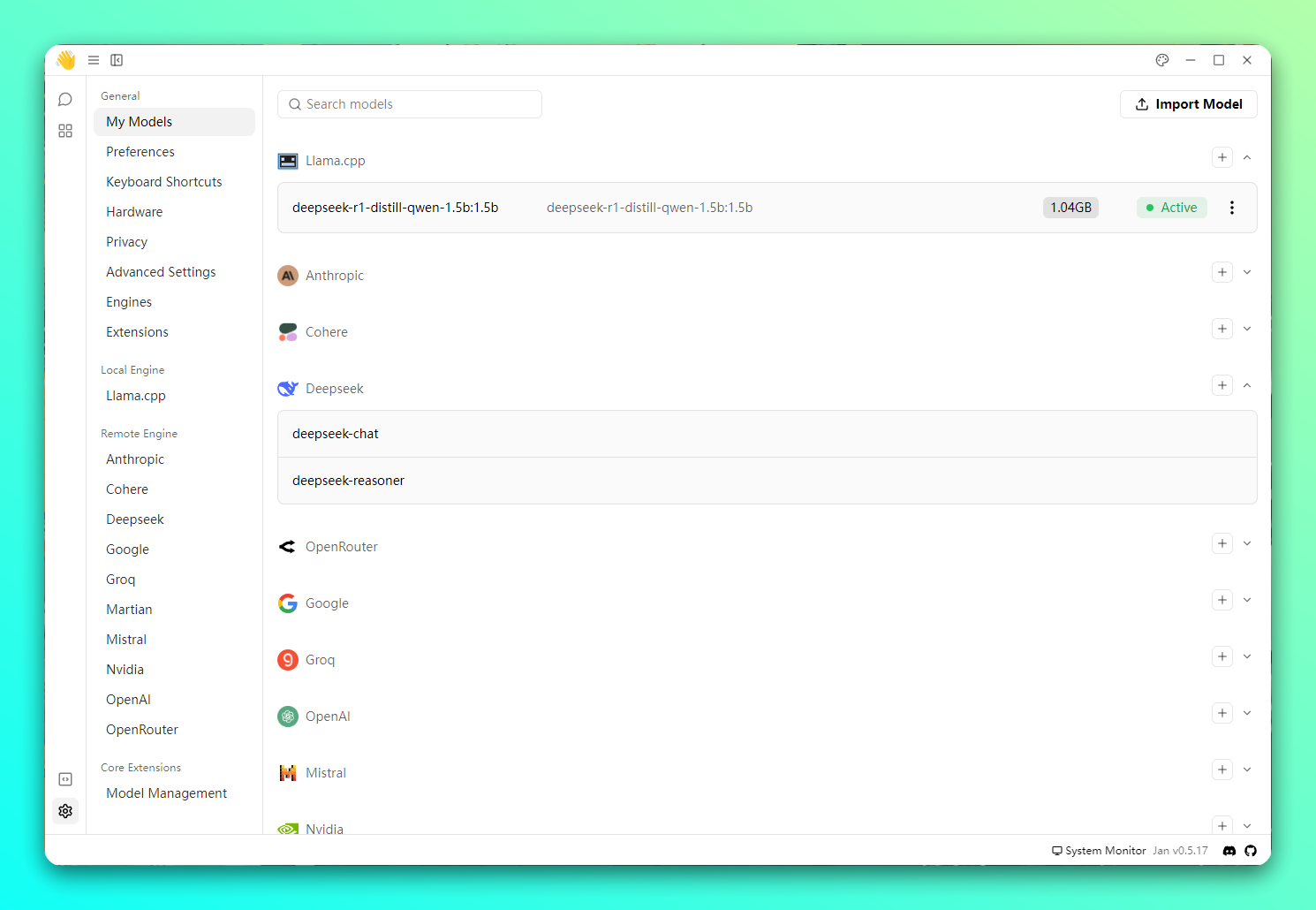

- 支持离线使用开源模型:(如 Llama、Mistral、Gemma 等),也允许连接 OpenAI、Groq 、DeepSeek 等远程 API 作为补充。

- 跨平台与硬件兼容:支持 Windows 10+/macOS 12.6+/Linux Debian 系统。

- GPU 加速优化:在 NVIDIA GPU(需 CUDA 驱动)和 Apple M 系列芯片上性能显著提升。

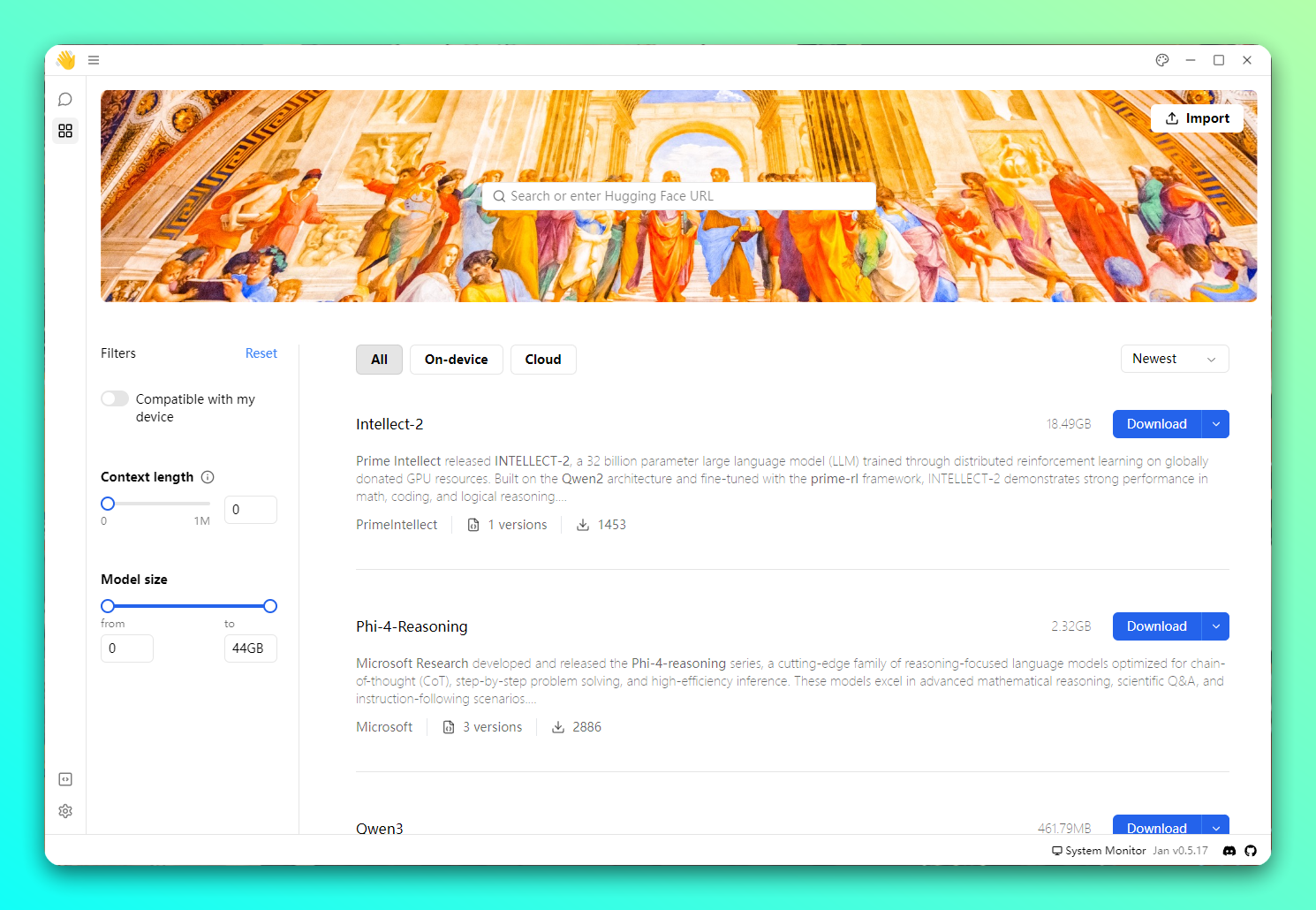

- 多模型与引擎支持:兼容 20+ 开源模型(GGUF、TensorRT 格式),可通过内置 Hub 下载或手动导入 Hugging Face 模型。

- 双推理引擎:默认集成 llama.cpp(轻量高效),支持 TensorRT-LLM(高性能推理)。

- 扩展性与开发支持:提供本地 API 服务器,兼容 OpenAI API 格式,便于集成第三方应用(如 LangChain)。

推荐LLM安卓macOSiOS