DeepSeek 导航网:console-chat-gpt v6 直接从命令行与 OpenAI、MistralAI、Anthropic、xAI、Google AI、DeepSeek、 阿里巴巴 、Inception 或 Ollama 托管的模型的无缝交互,高效、轻松地提升您的聊天体验。

功能特色

- 支持 OpenAI 的 API

- 运行任何兼容 OpenAI SDK 的模型 - 只需将模型结构与相关 model_name base_url 添加到 config.toml 文件中即可。

- 在本地运行 Ollama 托管模型

- 完全支持 Anthropic Prompt

- 支持模型上下文协议 (MCP)!如果您已经在使用 MCP 服务器,只需将您的 claude_desktop_config.json 复制到根目录并重命名为 mcp_config.json 即可开始使用任何模型!

- 统一聊天完成功能分离为独立库,可用于任何应用程序,以实现无缝的跨提供商 API 体验。源代码以 Python 和 TypeScript 格式提供

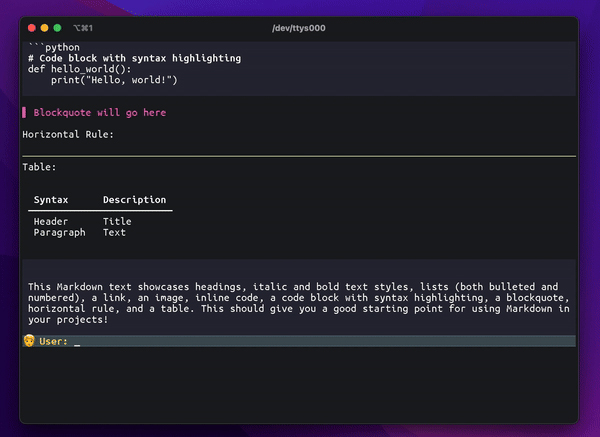

- 可以在设置菜单中启用所有受支持型号的流式传输(默认处于禁用状态)

- 完全支持 OpenAI 助手 Beta 版

- AI 管理模式根据任务的复杂程度,自动确定要使用的模型。

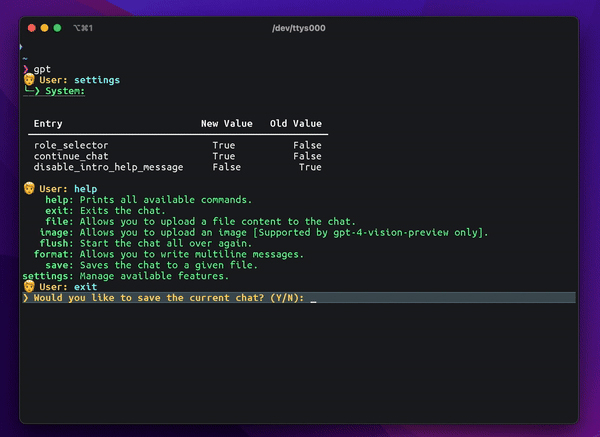

- 配置文件 :通过 config.toml 文件轻松自定义应用程序的设置,以完全控制应用程序的工作方式。也支持通过 settings 命令在应用程序内使用。

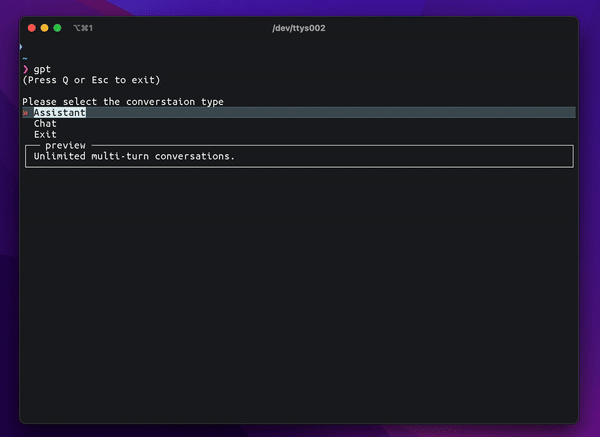

- 角色选择 :用户可以定义 AI 在对话中的角色,从而获得更加个性化和交互式的体验。

- 温度控制 :调整生成的响应的温度,以控制对话中的创造力和随机性。

- 命令处理 : 该应用程序响应用户输入的各种命令,以实现轻松直观的交互。

- 图像输入 :使用选定的模型。

- 错误处理 :清晰有用的错误消息,可轻松理解和解决任何问题。

- 对话历史 :查看以前的交互并保存对话以供将来参考,从而提供上下文和连续性。

- 优雅退出 :顺利处理中断,确保在退出前保存对话,以免丢失进度。

安装和使用

该脚本在 Linux 和 MacOS 终端上运行良好。对于 Windows ,建议使用 WSL。

克隆存储库:

git clone https://github.com/amidabuddha/console-chat-gpt.git

进入文件夹:

cd console-chat-gpt安装必要的依赖项:

python3 -m pip install -r requirements.txt

根据您选择的 LLM ,从 OpenAI、MistralAI、Anthropic、xAI、Google AI Studio、DeepSeek、 阿里巴巴 、Inception 获取您的 API 密钥。

首次运行时,

config.toml.sample将自动复制到config.toml中,并提示输入 API 密钥。请根据您的需要随意更改设置应用程序内菜单中不可用的任何其他默认值。运行可执行文件:

python3 main.py

专业提示:为可执行文件创建别名,以便从任何位置运行。

在聊天中使用

help命令检查可用选项。

下载地址

- Github:访问

LLMmacOSMCP