DeepSeek 导航网:CodeCompanion 是一种生产力工具,可简化您在 Neovim 中使用 LLMs 进行开发的方式。

功能特色

- 💬 Copilot Chat 在 Neovim 中遇到 Zed AI

- 🔌 支持 Anthropic、Copilot、GitHub Models、DeepSeek(申请 DeepSeek API)、Gemini、Mistral AI、Novita、Ollama、OpenAI、Azure OpenAI、HuggingFace 和 xAILLMs ,开箱即用(或自带!

- 🫶 用户提供和支持的适配器

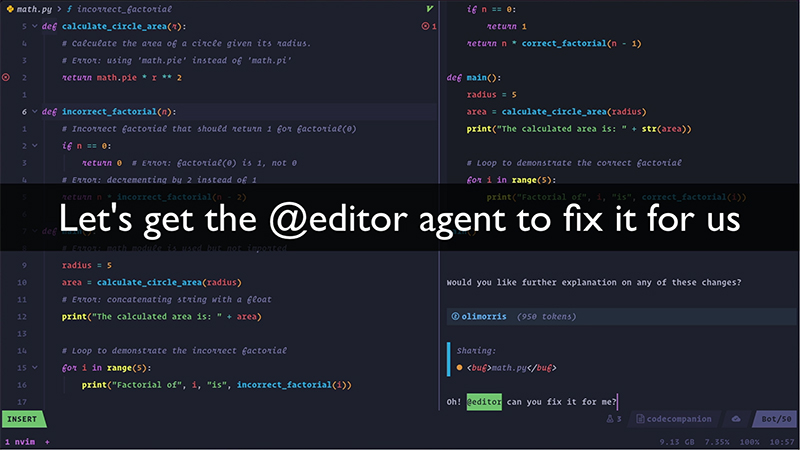

- 🚀 内联转换、代码创建和重构

- 🤖 用于提高 LLM 输出的变量、斜杠命令、代理/工具和工作流程

- ✨ 内置提示库,用于常见任务,例如 LSP 错误建议和代码解释

- 🏗️ 创建您自己的自定义提示符、变量和斜杠命令

- 📚 同时打开多个聊天

- 💪 异步执行以实现快速性能

插件概述

该插件使用适配器连接到 LLMs 。该插件开箱即用,支持:

- Anthropic (

anthropic) - 需要 API 密钥并支持提示缓存 - Copilot (

copilot) - 需要通过 Copilot.vim 中的:Copilot 设置创建的令牌 - GitHub 模型 (

githubmodels) - 需要安装并登录gh - DeepSeek (

deepseek) - 需要 API 密钥 - Gemini (

gemini) - 需要 API 密钥 - HuggingFace (

huggingface) - 需要 API 密钥 - Mistral AI (

mistral) - 需要 API 密钥 - Novita (

novita) - 需要 API 密钥 - Ollama (

ollama) - 本地和远程托管 - OpenAI (

openai) - 需要 API 密钥 - Azure OpenAI (

azure_openai) - 需要具有模型部署的 Azure OpenAI 服务 - xAI (

xai) - 需要 API 密钥

该插件使用称为 strategies 的对象。这些是用户与插件交互的不同方式。 聊天策略利用缓冲区来允许与 LLM. 内联策略允许将 的输出 LLM 直接写入预先存在的 Neovim 缓冲区。

该插件允许您为每个策略以及每个 prompt 库条目指定适配器。

下载地址

- 官方网站:访问

API